«Si se hallase un loro que respondiese a todo, afirmaría sin dudarlo que es un ser pensante» [1]. Denis Diderot, Pensées philosophiques (1746)

«La capacidad de hablar no te hace inteligente». Qui-Gon Jinn a Jar Jar Binks en La amenaza fantasma (1999)

Como en tantos otros medios, en el videojuego una conversación entre dos personajes puede ser perfectamente silenciosa, en el sentido de que no hay palabras o estas no transmiten información concreta. Es el terreno en el que se hallan obras como Journey (Thatgamecompany, 2012), que elabora el tema de la amistad en términos completamente mudos. El jugador se encuentra con otros viajeros con los que no puede hablar. La comunicación es silenciosa, grácil, y abarca una visión pragmática de la amistad, creando un magnífico ejemplo de metáfora interactiva.

Esta es, vista así, una de las formas de diálogo más naturales que podemos imaginar en un videojuego; el no va más del diálogo interactivo. Por eso mismo resulta irónico que, en un medio con un indispensable fundamento tecnológico, las experiencias más puras se obtengan cuando no hay ni rastro de agentes artificiales, en una escena en la que no hay palabras y en la que el otro personaje no está controlado por la CPU. El mejor diálogo parece ser aquel en el que tomamos la palabra sin inteligencias artificiales de por medio.

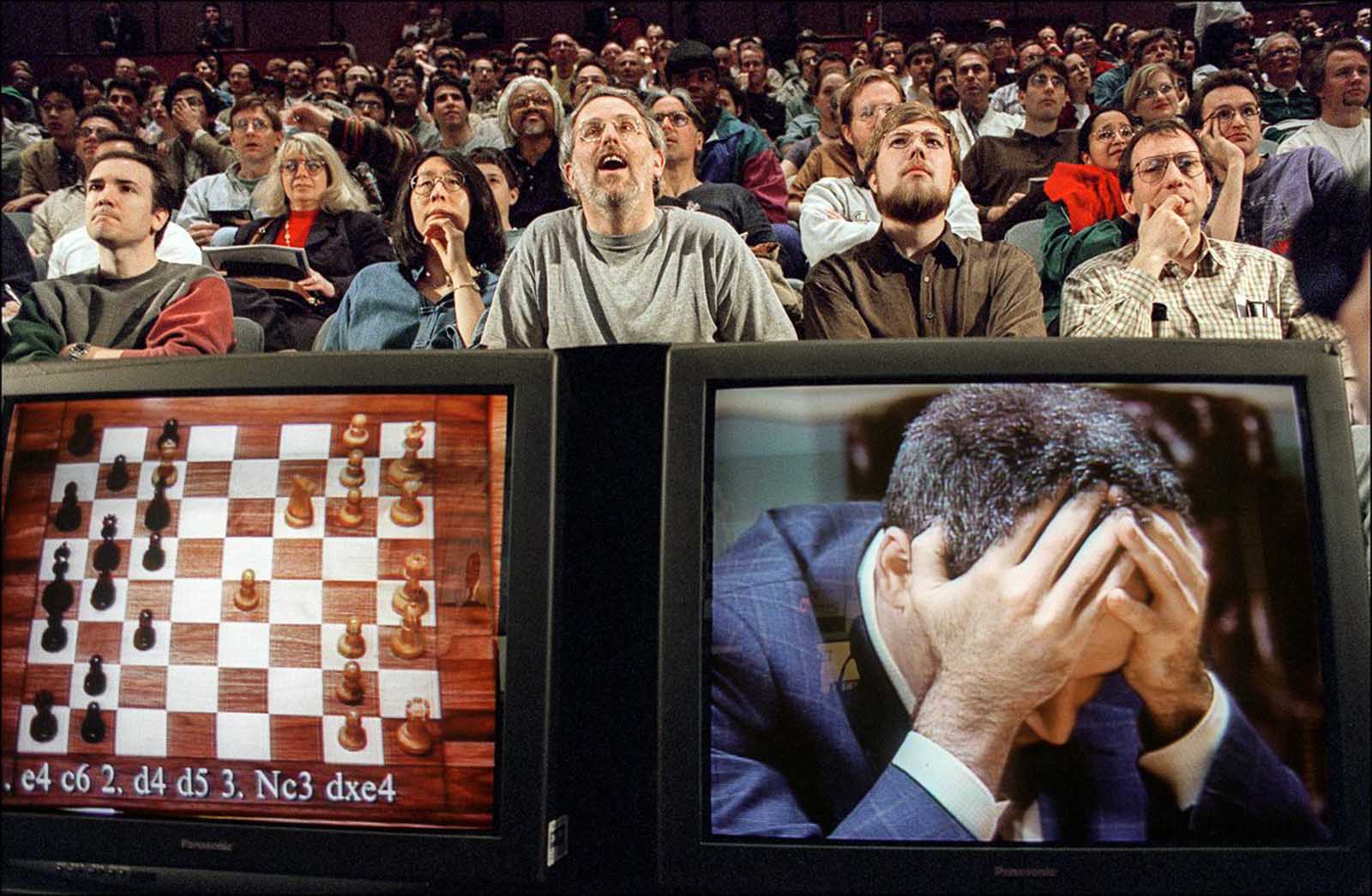

Hablemos un poco de inteligencias artificiales. Cuando en 1997 el supercomputador de IBM Deep Blue venció al campeón mundial de ajedrez del momento, Garry Kasparov, la comunidad científica vio cómo su concepción de la disciplina había de ser completamente replanteada. No es que fuese algo del todo inesperado (las líneas de investigación ya iban por otros derroteros), pero era la demostración de que una máquina puede superar al ser humano al ajedrez y, sin embargo, no ser inteligente. Todo apuntaba a que la inteligencia no radica en aquello que requiere complejas reflexiones. Como ya adelantaba Donald Knuth, «la inteligencia artificial ha conseguido hasta la fecha superarnos en todo aquello que requiere “pensar” y, sin embargo, ha fracasado en todo aquello que los seres humanos y otros animales hacemos “sin pensar”» [2].

Los espectadores observan el juego decisivo entre Kasparov e IBM Deep Blue, en mayo de 1997 / FOTO: Rare Historical Photos

Los espectadores observan el juego decisivo entre Kasparov e IBM Deep Blue, en mayo de 1997 / FOTO: Rare Historical Photos

La derrota de Kasparov supuso un hito que removió el mundo académico, pero no hay que escalar hasta las torres de marfil del academicismo para encontrarnos con la inteligencia artificial. En los videojuegos está ahí cada vez que nos disparan, cada vez que adelantamos a un contrincante controlado por la CPU en el último Mario Kart, y también cada vez que hablamos con un personaje no jugable. Pero no les prestamos demasiada atención. Ninguno de los complejos algoritmos que funcionan en segundo plano logran sorprendernos; ninguna de sus inventivas formas de reproducir la inteligencia humana logran provocar el más mínimo asombro.

Tal vez se deba, como comentaba el famoso informático John McCarthy —quien acuñó el nombre de la disciplina— a que «en cuanto funciona, dejamos de llamarlo inteligencia artificial» [2]. La otra posibilidad es que en el videojuego aún haya algo pendiente, que realmente no funciona. Algo que pone tan de relieve los límites de la simulación que nos recuerda constantemente que la interacción está limitada a lo que sus creadores han tenido a bien programar: el diálogo en el entretenimiento interactivo.

Partimos de un consenso generalizado: el diálogo en el videojuego contemporáneo está aún muy lejos de pasar el test de Turing. Se trata de un recurso narrativo —y a veces jugable— fundamental en el medio, pero su evolución deja mucho que desear. Estamos discurriendo en torno a la línea divisoria —bastante difusa— entre el diálogo pasivo (como lectura) y el diálogo como actividad (tomar la palabra). Y, entre esos dos paradigmas, hay toda una variedad de aproximaciones.

Cuando hablan los demás, el diálogo en el videojuego dista mucho de ser interactivo y en su análisis destaca principalmente la asimilación del lenguaje literario. En The Legend of Zelda: Breath of the Wild (Nintendo, 2017) el diálogo es clave para conocer a sus personajes: el tartamudeo de un niño tímido está recogido en el texto mediante el uso de guiones y palabras entrecortadas, la dicción ceceante de una niña está representada con zetas en todas sus palabras, el aparte de una chica que se ruboriza ante Link se expresa en una tipografía menor, la información relevante se remarca en colores llamativos, la velocidad a la que el texto aparece en pantalla se ajusta al ritmo de la escena y del personaje, e incluso los goron transmiten su goropersonalidad a través del dichoso goroprefijo. En definitiva, todo estaba ya en la literatura. En concreto en el teatro, que ha elaborado siempre el diálogo por el diálogo, convirtiéndolo en motor e hilo de la trama.

En el videojuego, el diálogo como motor e hilo de la trama surge más bien en forma de monólogo. Lo encontramos en los ecos metálicos de GLaDOS en Portal (Valve Corporation, 2007) o en la voz de Davey Wreden en The Beginner’s Guide (Davey Wreden, 2015). A través de estos soliloquios, los personajes hablan al jugador y este empieza a tener cierto margen para la interacción. Es aquí donde empiezan a llegar las primeras respuestas. En el mismo Portal, Chell es completamente muda, pero eso no nos impide retar a GLaDOS con nuestras acciones y hacer que reaccione a algunas de ellas (especialmente en el tramo final). Estamos “dialogando” con ella.

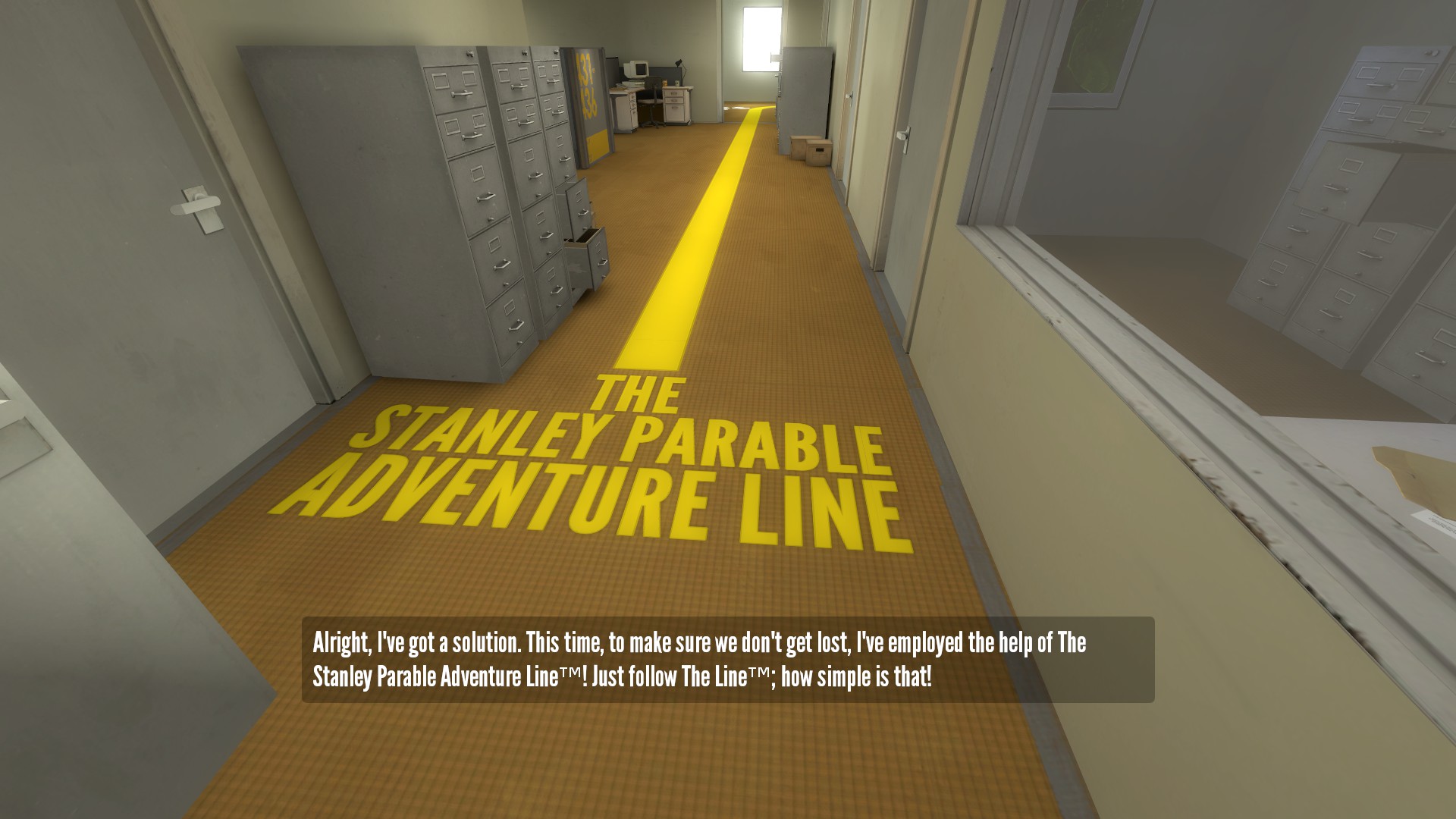

Algo similar, aunque a mayor escala, ocurre en la ópera prima de Wreden junto a William Pugh, The Stanley Parable (Galactic Café, 2013), que desdobla a sus dos personajes en los dúos jugador-avatar y narrador-creador. Cada una de las acciones del jugador a través de Stanley encuentra respuesta en las palabras del narrador, escritas por un tercero, el “creador”. No “hablamos” con él, pero a través de nuestra relación con él estamos dialogando con la obra.

The Stanley Parable es un buen ejemplo en la transición hacia modelos en los que el jugador tiene algo más que decir en la conversación con su entorno. Además, pone de manifiesto dos cuestiones relevantes: que el diálogo puede ser perfectamente silencioso en el videojuego, y que, por muy naturales que parezcan las respuestas del narrador, seguimos estando ante un árbol con un número finito de ramas. No parece factible escapar a las limitaciones materiales.

Con todo, en estos ejemplos el jugador no llega a “tomar la palabra”. En la gradación hacia una mayor participación del jugador, el diálogo como hilo nos lleva al diálogo como investigación, presente en muchos walking simulators —Everybody’s Gone to the Rapture (The Chinese Room, 2015), Gone Home (Fullbright, 2013), Cibele (Nina Freeman, 2015), What Remains of Edith Finch (Giant Sparrow, 2017)—. Aquí el jugador se limita a leer toda clase de documentos, pero puede decidir el orden en el que lo hace, además de sacar sus propias conclusiones. Es una lectura mucho más próxima a la literatura ergódica que a literatura convencional.

En términos de interacción, el mayor exponente es Tacoma (Fullbright, 2017), que, aunque dotado de mayor linealidad entre sus escenas, plantea grabaciones mucho más interactivas. Aquí el espacio juega un papel clave y una misma grabación ofrece múltiples perspectivas. Jugablemente es el equivalente a una representación de teatro en la que el jugador se mueve libremente por el escenario mientras rebobina o acelera la escena. Nos encontramos ante un diálogo con un entorno deshabitado, con personajes que ya no están. Es el fenómeno del jugador voyeur: miramos y conocemos a los personajes a través del entorno que habitaron, pero no tenemos libertad para dejar nuestra huella.

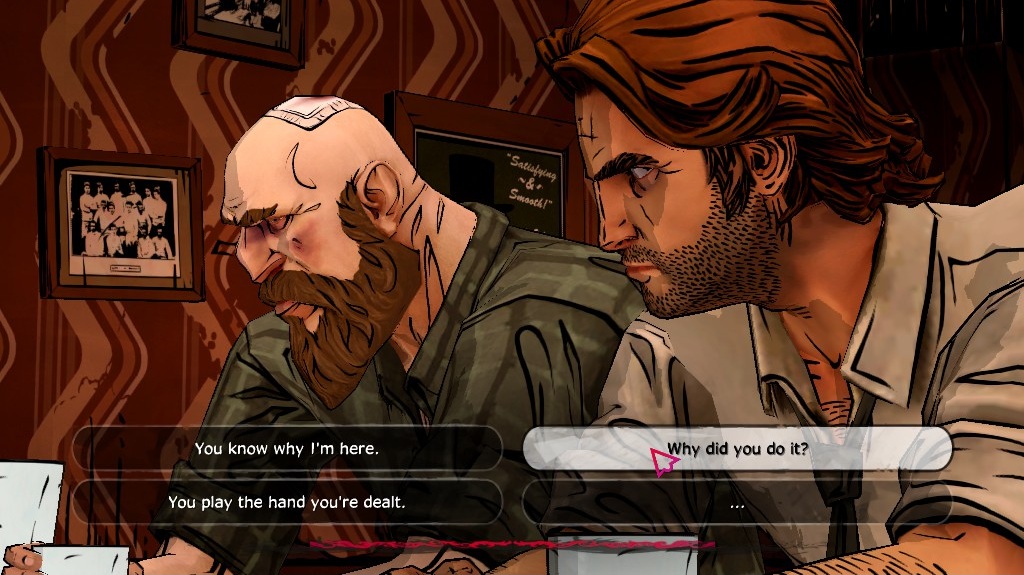

Al fin y al cabo, en esa gradación desde la lectura hasta tomar la palabra es inevitable darse de bruces con un problema tan antiguo como el videojuego: el de la libertad del jugador. La autonomía que ofrecen la mayoría de sistemas se enmarca en una concepción griega clásica de la libertad: capacidad de elección entre las opciones dadas, sin posibilidad de construir nuevas alternativas. El problema entronca también con el recurrente «dilema interactivo»: la tensión entre la libertad del jugador de modificar la historia y la necesidad del autor de controlarla para que los aspectos temáticos no varíen. De esta disyuntiva se derivan también importantes cuestiones referentes a la elección entre las opciones de diálogo, que se condensan en la avataridad (como quién jugamos, como quién respondemos).

En realidad, todos estos problemas de libertad estaban ya en los inicios. En los años 70, la interacción estaba dirigida por el diálogo debido a un género clave: la aventura conversacional. Su popularidad surge en 1977, cuando Colossal Cave Adventure (Willie Crowther y Don Wood, 1976) comienza a distribuirse a través de ARPAnet. En Colossal Cave, Zork (Infocom, 1980) y títulos posteriores, la interacción se fundamentaba en texto. Existía, literalmente, una conversación escrita entre el lector y la obra. Por eso es muy importante entender el papel clave que juega el diálogo en el medio videolúdico —y por eso es tan triste que los avances hayan sido relativamente escasos—.

Decía al principio que el diálogo interactivo no pasa aún el test de Turing, pero a lo mejor he ido demasiado deprisa: no hemos hablado de qué supone identificar la inteligencia con la capacidad de hablar, todo un clásico en la historia de las ideas. En 1746, Diderot escribió que «si se hallase un loro que respondiese a todo, afirmaría sin dudarlo que es un ser pensante». Entre los intelectuales de su talla capaces de rebatirle destaca el personaje de Qui-Gon Jinn en La amenaza fantasma (George Lucas, 1999) que le espeta a Jar Jar Binks que «la capacidad de hablar no te hace inteligente». Para Diderot basta con aparentar inteligencia; para otros, es necesario «pensar».

El test de Turing es, en este contexto, el elemento definitorio de uno de los dos grandes paradigmas de la inteligencia artificial: el de los «agentes que actúan como humanos», que buscan imitar sus acciones, en contraste con los llamados «agentes racionales», que actúan según reglas lógicas rigurosas y precisas. Para unos basta con imitar el comportamiento humano mientras que, para otros, de nada sirve una imitación fiel si no hay nada detrás; si no entendemos cuál es el núcleo de la inteligencia. Unos (los de los agentes humanos) son los defensores de las corrientes conexionistas de IA, bioinspiradas en las redes neuronales; los otros son los seguidores del logicismo russelliano y el formalismo de la escuela de Hilbert, centrado en la programación basada en reglas y el razonamiento automático [3].

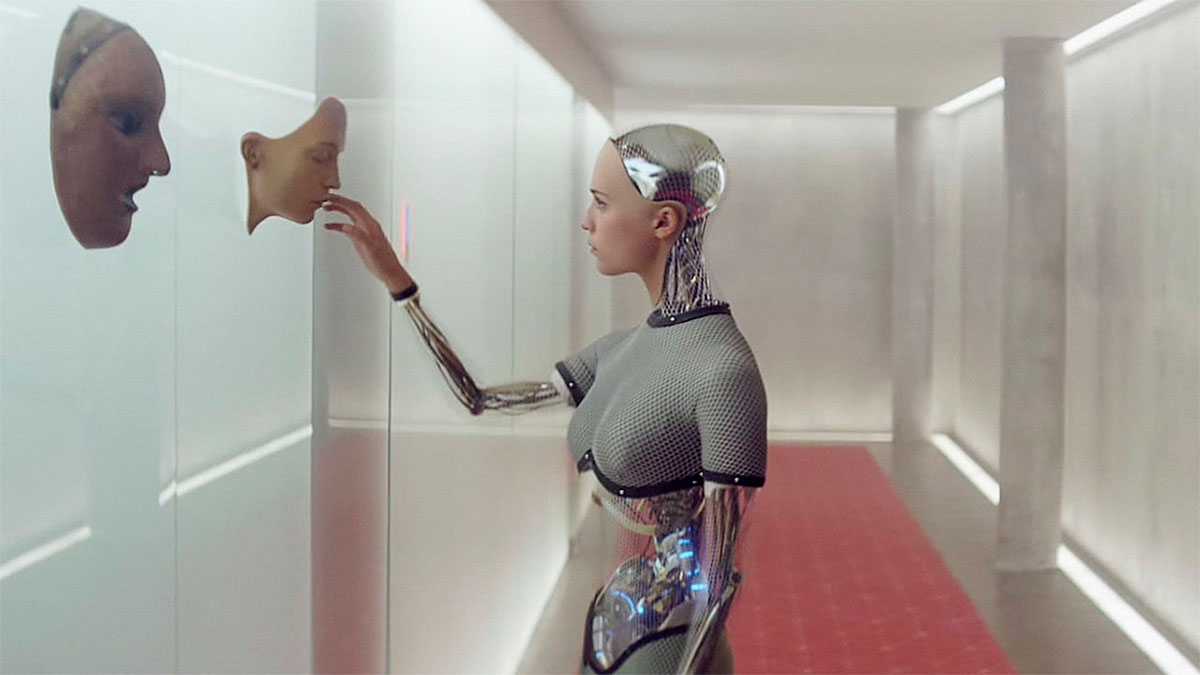

Un fragmento de la película Ex Machina (Alex Garland, 2015).

Un fragmento de la película Ex Machina (Alex Garland, 2015).

De hecho, la derrota de Kasparov contra Deep Blue se vuelve mucho más profunda si la interpretamos a la luz de estas clasificaciones. Las expectativas puestas sobre la partida de ajedrez se remontan a 1958, cuando el informático Allen Newell aseguró que «si alguien pudiese idear una máquina de ajedrez perfectamente funcional, ese alguien habría penetrado en el núcleo del esfuerzo intelectual humano» [2]. Creía, razonablemente, que un ordenador capaz de jugar al ajedrez habría desarrollado altos niveles de «inteligencia general».

Nada más lejos de la realidad, incluso pese a las declaraciones del propio Kasparov, que aseguró haber visto retazos de auténtica inteligencia y creatividad en los movimientos de la máquina. Deep Blue —como los algoritmos que resuelven sudokus mediante backtracking o la IA enemiga de cualquier videojuego— era un sistema de propósito particular. Superaba el umbral marcado por Newell, pero no era inteligente.

La partida de ajedrez es, con todo, un socorrido método para determinar la autenticidad de la inteligencia artificial, especialmente para aquellos investigadores en busca de agentes que imiten al ser humano. La idea aparece ya en la primera formulación del famoso «test de Turing» en 1947: un sujeto juega al ajedrez contra una persona real y contra una máquina, sin saber a quién se enfrenta en cada momento. La formulación más conocida, sin embargo, aparece en su conocido artículo de 1950, Computing Machinery and Intelligence: el «juego de la imitación», the imitation game. Una persona mantiene una conversación a través de un ordenador, sin ser capaz de distinguir si está hablando con un ser humano al otro lado o con la propia máquina. En esta situación, el ordenador estaría mostrando comportamiento inteligente equivalente al humano… o al menos indistinguible.

El test de Turing pone de relieve que el progreso en el diálogo interactivo pasa ineludiblemente por tomar la palabra; lograr una conversación más natural y orgánica con la inteligencia artificial que habita los espacios ludoficcionales. Y, sobre todo, los dos elementos que lo definen como pilar de la corriente simulacionista de la IA afectan directamente al videojuego: el componente conversacional y el hecho de que la conversación parezca la de un ser humano. Tradicionalmente, las técnicas desarrolladas para construir agentes humanos han sido radicalmente distintas de las empleadas por los investigadores defensores de los agentes racionales. Su incursión en el diálogo, sin embargo, pasa por entenderlas como complementarias.

Es la opinión de autoras como Emily Short, ahora en SpiritAI, que se encuentra al frente de uno de los proyectos más ambiciosos de la escena tecnológica actual: Character Engine. Se trata, en resumidas cuentas, de un entorno en el que la inteligencia artificial genera diálogo en tiempo real en respuesta a las palabras del jugador; un middleware que combina conocimiento particular de la escena, conocimiento general del entorno y conocimiento sobre la lengua para imbuir a los personajes no jugables de mayor naturalidad.

Emily Short durante una conferencia en Digital Cultures 2018 en la ciudad alemana de Luneburgo.

Emily Short durante una conferencia en Digital Cultures 2018 en la ciudad alemana de Luneburgo.

Sus esfuerzos van dirigidos a un motor que pivota sobre dos pilares fundamentales: la investigación del lenguaje en su función social y la cuestión puramente técnica de generarlo artificialmente. En lo social, apuntan a entender el comportamiento conversacional humano. En lo técnico, Short concibe unas «matemáticas en el espacio vectorial del lenguaje» [5]. Todo ello sin perder de vista que lo que hacemos es simular el diálogo natural. La simulación perfecta es seguramente imposible, así que «se trata de hacer que todo sea más fluido, que los límites de la simulación se difuminen, no para que desaparezcan, sino para que, al encontrarlos, el guion te redirija de manera natural a la trama» [6]. Y para ello hay un intento de reconciliación entre esos dos paradigmas de la inteligencia artificial: mezcla aprendizaje automático con sistemas expertos, lógica difusa con nociones de modelos sociales y ciencia de datos, y todo ello aderezado con generación procedimental de texto y procesamiento natural del lenguaje.

Todo esto, en cierto modo, funciona sobre el modelo clásico del diálogo interactivo, sobre el que menos hemos hablado antes: el del diálogo basado en las opciones predefinidas de los árboles conversacionales. Los recursos de la literatura convencional son aquí fundamentales de cara a redactar buenas respuestas, pero la cuestión crucial que emerge de la mecánica de elección es el problema de la libertad. Y no debemos olvidar, eso sí, que las herramientas como Character Engine no resuelven ninguno de esos problemas (el dilema interactivo, la avataridad…) sino que, más bien, los «disuelven»; son una sofisticación de los árboles de diálogo en los que la inteligencia artificial lo vuelve todo más natural. Intervienen de nuevo aquí los recursos literarios. Al fin y al cabo, escribir buen diálogo —verosímil, cohesionado, natural— no es tarea fácil, y el videojuego tiene mucho que aprender.

De nuevo, de nada sirven las herramientas informáticas sin el componente literario. De hecho, nada sería más erróneo que pensar que el progreso del videojuego contemporáneo y su lenguaje dependen de progresos tecnológicos. Al fin y al cabo, la base tecnológica del videojuego ha motivado la nociva concepción de que solo podremos desarrollar mejores juegos con mayor potencia de cómputo y capacidad gráfica. También ha provocado el problema de la conservación de las obras a causa de la obsolescencia y las prácticas comerciales de la industria (un debate más al día que nunca). Precisamente por todo ello, el videojuego necesita abstraerse de los circuitos integrados en los que se ejecuta para desarrollar plenamente su lenguaje. Y, por imposible que parezca, debe hacerlo sin olvidar dónde están sus bases.

No tiene que olvidar, además, que el diálogo es mucho más amplio que todo esto, es cualquier comunicación entre el jugador y la obra. Es ese diálogo silencioso que tiene lugar en Journey, y que también es una constante en la obra de Fumito Ueda, alcanzando su punto álgido en The Last Guardian (Team ICO, 2016), donde, de nuevo, la inteligencia artificial de Trico juega un papel central.

Porque, en realidad, el diálogo no se limita a las palabras de la conversación. Se extiende a todo el sistema. También es diálogo lo que ocurre en Dishonored, (Arkane Studios, 2012), Prey (Arkane Studios, 2016) u otros simuladores inmersivos, que invitan al jugador a llevar el juego a sus límites; a relacionarse con sus sistemas. En todos estos ejemplos, el diálogo es mucho más de lo que parece y, a la vez, está estrechamente ligado a las cuestiones de la inteligencia artificial y de la libertad que afectar al medio desde sus inicios. Son todas cuestiones pendientes si aspiramos a pasar el test de Turing a algún día. Todo sea por tomar la palabra.

NOTAS:

[1] Denis (1746) Pensamientos filosóficos y el combate por la libertad, traducción de Judith Cobeña i Guàrdia, Proteus Libros (2009)

[2] Nick (2014) Superintelligence: Paths, Dangers, Strategies, cap 2: Past developments and present capabilities – State of the art, pág. 11-14, Oxford University Press

[3] Stuart J. y Norvig, Peter (1995) Artificial Intelligence: A Modern Approach, caps. 1.1 – What Is AI? y 1.2 – The Foundations of Artificial Intelligence, Prentice Hall

[4] Alan (1948) Machine Intelligence, citado en Copeland, B. Jack (2004) The Essential Turing: The ideas that gave birth to the computer age, Oxford University Press

[5] Emily (2017) The uncanny mirror: seeing ourselves in AI, conferencia durante el GameLab 2017, disponible en YouTube

[6] Nº 308 (2017) Machine language: One startup’s quest to use AI to bring game dialogue to life, págs. 9-11